مع تزايد الاعتماد على تقنيات الذكاء الاصطناعي في مختلف مجالات الحياة، اتسع نطاق استخدامها ليشمل ساحات القتال، بحيث تتحول الجبهات إلى مختبرات حية للتجريب والتطوير، خصوصا في النزاعات ذات الطابع غير المتكافئ.

وفي طليعة هذه الجبهات تقف إسرائيل، التي كشفت تقارير إعلامية غربية وإسرائيلية أخيرا عن استخدامها المتسارع والمتقدم لأنظمة الذكاء الاصطناعي خلال عملياتها العسكرية في غزة ولبنان، واعتماد الجيش الإسرائيلي خلال الأشهر الماضية على أنظمة ذكاء اصطناعي متطورة لدعم عملياته العسكرية، خاصة في قطاع غزة ولبنان، مما أثار تساؤلات واسعة حول الأبعاد الأخلاقية والقانونية لهذا الاستخدام.

وبحسب ما نشرته صحيفة "نيويورك تايمز" وصحف أخرى، فإن إسرائيل نشرت منظومات ذكاء اصطناعي قادرة على تحليل الصور والنصوص واعتراض المحادثات الإلكترونية، بل واتخاذ قرارات شبه مستقلة في ميادين المعركة.

وأكدت مصادر عسكرية إسرائيلية أن وحدة الاستخبارات "8200" لعبت دورا محوريا في تطوير هذه التقنيات. فقد أنشأت الوحدة ما يُعرف بـ"الأستوديو"، وهو مركز متقدم يضم نخبة من خبراء التكنولوجيا الذين طوروا برامج تعتمد على الذكاء الاصطناعي لرصد وتحليل بيانات ضخمة قادمة من ساحات القتال.

ذراع الكترونية

والوحدة 8200، هي الذراع الإلكترونية لأكبر الأجهزة الاستخبارية الإسرائيلية "أمان"، وقد تأسست قبل ثلاثة عقود لتقود عمليات التجسس الإلكتروني وجمع الإشارات وفك الشيفرات وقيادة الحرب الإلكترونية، معتمدة على أحدث ما أنتجته الصناعات العسكرية الإسرائيلية والتقنيات المتطورة، وبمساندة واسعة من شركات القطاع الخاص.

وطورت تلك الوحدة قدرات لمعالجة ملايين الاتصالات يوميا لاستخلاص المعلومات الاستخبارية، مستفيدة من سيطرة إسرائيل على شبكات الاتصالات في الضفة الغربية وغزة. فالهواتف وشبكات المحمول مربوطة عمليا بالشبكات الإسرائيلية مما يجعل التنصت مهمة روتينية وسهلة، كما لعبت الوحدة دورا محوريا في الحرب الإلكترونية ضد إيران، بتطوير فيروس "ستوكسنت" لتعطيل برنامجها النووي.

ولم تكتف الوحدة بمهام الرصد والتنصت بل امتدت عملياتها إلى زرع أجهزة تجسس في عمق الدول العربية، وكشفت صحيفة "نيويورك تايمز" في مارس/آذار 2024 أن الوحدة استخدمت تقنيات تعرف على الوجه لتعقب الفلسطينيين خلال حرب غزة الأخيرة.

وتجري تلك العمليات بالتنسيق الوثيق مع وحدة "سييرت متكال" النخبوية المسؤولة عن تنفيذ الاغتيالات وجمع المعلومات، بينما يتسابق قطاع التكنولوجيا الإسرائيلي إلى توظيف متخرجي الوحدة الذين أسسوا لاحقا عشرات الشركات التكنولوجية الرائدة في العالم، مما يجعل من وحدة 8200 ليس مجرد وحدة عسكرية بل تكون مصنعا سريا للقوة الإلكترونية الإسرائيلية الحديثة.

وقالت "نيويورك تايمز" إن أحد أهم المشاريع التي قامت بتطويرها تلك الوحدة حديثا يتمثل في بناء نموذج لغوي ضخم قادر على فهم النصوص باللهجات العربية العامية، في خطوة هدفت إلى سد فجوة ظلت قائمة لسنوات بسبب قلة البيانات باللهجات مقارنة باللغة العربية الفصحى.

كيف تم بناء ذلك النموذج؟

ويتطلب بناء ذلك النموذج اللغوي الضخم جهدا هائلا يبدأ أولا بتجميع كمّ ضخم من البيانات العامية المبعثرة، حيث إن اللهجات لم تحظَ بتوثيق أكاديمي كالفصحى.

واستلزم النموذج استخراج النصوص من وسائل التواصل الاجتماعي، تعليقات المستخدمين، والسكريبتات الفنية، والمحادثات اليومية، مع الانتباه إلى أن هذه النصوص مليئة بالأخطاء والرموز العشوائية مما يفرض الحاجة إلى عمليات تنظيف معقدة تزيل الضوضاء دون أن تفقد النص روحه العامية.

بعد جمع وتنظيف البيانات تم تعديل أو تصميم نماذج لغوية حديثة قادرة على التعامل مع تنوع اللهجات كما لو كانت لغات مستقلة أو لهجات متفرعة ضمن شبكة لغوية واحدة، عبر استخدام تقنيات مثل التعلم المتعدد اللغات ونماذج التحويلات المتقدمة.

ثم تأتي مرحلة التدريب التي تتطلب موارد حوسبة ضخمة وتكاليف باهظة مع التركيز على لهجة واحدة أو مجموعة لهجات ذات كثافة بيانات مرتفعة، وبعدها يجب إخضاع النموذج لاختبارات تقييم حقيقية عبر ناطقين أصليين بمختلف اللهجات لقياس قدرته على فهم النصوص الساخرة والعاطفية واليومية.

ولا يتوقف عند النسخة الأولى لأن اللهجات تتطور بسرعة مذهلة، مما يفرض استمرار تدريب النموذج وتغذيته ببيانات جديدة بصفة دورية، ليبقى قادرا على مواكبة الاستخدامات اليومية المتجددة.

نظام التعرف الى الوجوه

إحدى أبرز الأدوات التي تم الكشف عنها كانت نظاما مدمجا بالتعرف الى الوجوه، قادرا على تحليل صور الأشخاص حتى في حال كانت ضبابية أو جزئية.

إلا أن النظام، رغم قدراته، وقع أحيانا في أخطاء، أدت إلى توقيف فلسطينيين أبرياء جرى التعرف اليهم خطأ، مما أثار تساؤلات عن موثوقية هذه التكنولوجيا في ظروف الحرب.

وفي أعقاب اغتيال الأمين العام لـ"حزب الل"ه حسن نصر الله في سبتمبر/أيلول الماضي، استخدم الجيش الإسرائيلي أنظمته لتحليل المزاج الشعبي العربي عبر وسائل التواصل الاجتماعي لتقدير احتمالية وقوع رد عسكري على الاغتيال.

وأظهرت التقارير الصحافية مدى تغلغل الذكاء الاصطناعي الإسرائيلي في قراءة الرأي العام وتوقع ردود الفعل قبل وقوعها.

وكشفت مصادر أن إسرائيل زودت نقاط التفتيش المؤقتة على حدود غزة أنظمة ذكاء اصطناعي قادرة على تحديد الأشخاص عبر كاميرات حديثة، واكتشاف أي تغييرات مريبة، رغم التحديات المستمرة في دقة التعرف الى الوجوه.

ورغم كل هذه الإنجازات، لم تكن التكنولوجيا منزهة عن الأخطاء. فقد أشار ضباط استخبارات إسرائيليون إلى أن بعض النماذج اللغوية كانت ترتكب أخطاء فادحة، مثل تفسير صور أنابيب المياه على أنها أسلحة نارية، أو عدم فهم المصطلحات العامية الحديثة والمصطلحات الإنكليزية المعربة، وهو الأمر الذي استدعى تدخل محللين بشريين لمراجعة نتائج الخوارزميات وتصحيحها.

مع ذلك، أكد المسؤولون أن هذه الأدوات، برغم عيوبها، سرعت بشكل كبير عملية التحليل الاستخباري، مما أعطى إسرائيل أفضلية زمنية ثمينة في ميادين المعركة.

قرارات الحياة والموت

يطرح استخدام الذكاء الاصطناعي في العمليات العسكرية أسئلة معقدة حول حدود الشرعية والأخلاقيات. فبينما تصر إسرائيل على أنها تلتزم "معايير قانونية صارمة"، فإن غموض التفاصيل وعدم توفر رقابة مدنية حقيقية يثير قلق المراقبين الدوليين والمنظمات الحقوقية.

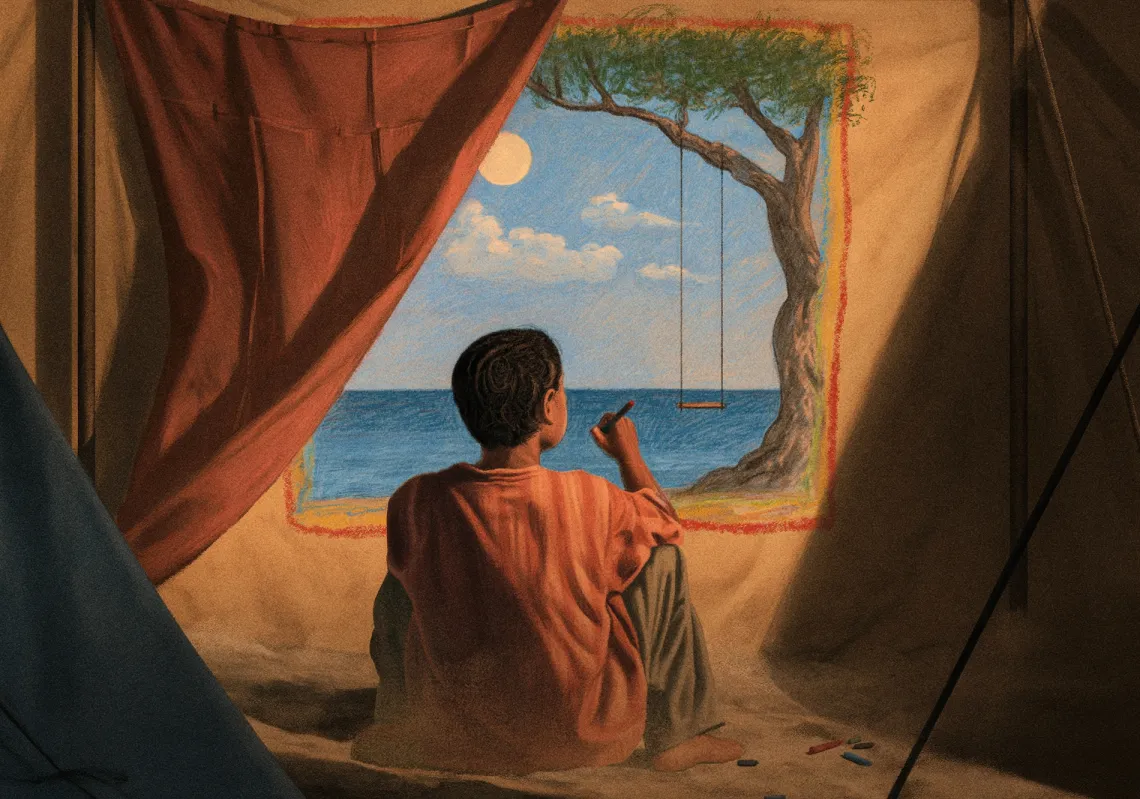

هناك تخوف حقيقي من أن يؤدي الاعتماد المفرط على الأنظمة الآلية إلى "أتمتة" قرارات مصيرية تتعلق بالحياة والموت، دون تدخل بشري كامل، مما قد يؤدي إلى انتهاكات جسيمة لقوانين الحرب.

يشهد العالم اليوم تأثير الذكاء الاصطناعي في مختلف جوانب الحياة الإنسانية. فقد عاين العقد الماضي ارتفاعا حادا في استخدام تقنيات الذكاء الاصطناعي، مثل برامج التعرف الى الوجوه، والمركبات الذاتية القيادة، ومحركات البحث، وبرمجيات الترجمة.

وبينما أصبح اعتماد هذه التقنيات جزءا لا يتجزأ من حياة المجتمعات الحديثة، تزايد في المقابل استخدامها في ساحات القتال الحديثة.

ومع تصاعد تسليح الذكاء الاصطناعي، يقارن بعض الخبراء هذا التحول بسباق التسلح النووي خلال الحرب الباردة، غير أن الأسلحة النووية اليوم تحل محلها أنظمة أسلحة آلية.

ولا تزال الأمم المتحدة والقانون الدولي يواجهان صعوبة في مواكبة هذه التغيرات السريعة وفي وضع إطار تنظيمي لاستخدام هذه الأنظمة.

وبدأ المجتمع الدولي يولي اهتماما جديا للذكاء الاصطناعي وتأثيره على الحروب الحديثة في عام 2012، عندما ظهرت مجموعة من الوثائق السياسية، من بينها توجيهات صادرة عن وزارة الدفاع الأميركية في شأن الاستقلالية في أنظمة الأسلحة، وتقرير مشترك لمنظمة "هيومن رايتس ووتش" و"جمعية حقوق الإنسان الدولية" التابعة لجامعة هارفارد، طالب بمنع شامل لتطوير الأسلحة الذاتية.

أصبحت مسألة تطوير واستخدام الأسلحة القادرة على أداء وظائف مستقلة أثناء النزاعات محور تركيز الدول وشركات التكنولوجيا الكبرى.

ففي عام 2017، وجه "معهد مستقبل الحياة" رسالة مفتوحة إلى الأمم المتحدة، وقعها 126 من الرؤساء التنفيذيين ومؤسسي شركات الذكاء الاصطناعي والروبوتات، طالبوا فيها الحكومات بالتحرك العاجل لمنع سباق تسلح على الأسلحة الذاتية.

ومع ذلك، لا يوجد حتى اليوم إطار قانوني دولي شامل ينظم استخدام الذكاء الاصطناعي في الحروب، باستثناء ما نص عليه العهد الدولي الخاص بالحقوق المدنية والسياسية -المادة 26- الذي ربط الذكاء الاصطناعي فقط بمسألة الحق في الخصوصية.

الأسلحة الذاتية

تتباين التعريفات في شأن ماهية "الأسلحة الذاتية". ففي عام 2011، عرّفت وزارة الدفاع البريطانية هذه الأنظمة بأنها "أنظمة قادرة على فهم النيات العليا واتخاذ قرارات لتحقيق الأهداف بمستوى فهم الإنسان نفسه". بينما تبنت وزارة الدفاع الأميركية في عام 2023 تعريفا أكثر مباشرة، معتبرة أن السلاح الذاتي هو "ذلك الذي يستطيع، بعد تفعيله، اختيار الأهداف والانخراط فيها دون أي تدخل بشري إضافي".

كما قدم تقرير "هيومن رايتس ووتش" لعام 2012 تعريفا مشابها، مشيرا إلى "الأسلحة المستقلة كليا القادرة على اختيار الأهداف ومهاجمتها دون تدخل بشري".

وتشمل أمثلة الأسلحة الذاتية منظومات دفاعية مثل "القبة الحديدية" الإسرائيلية و"مانتيس" الألمانية، وكذلك المركبات الدفاعية النشطة مثل "LEDS-150" السويدية.

غير أن التحدي الحقيقي يكمن في صياغة تعريفات مستقبلية تواكب التطورات المتلاحقة، بما يشمل نظم الذكاء الاصطناعي التي تحاكي الإدراك البشري وتتخذ قرارات معقدة.

رغم الحاجة الملحة، لم يتوصل المجتمع الدولي بعد إلى اتفاق حول تنظيم هذه الأسلحة، فالاتفاقية الأممية حول الأسلحة التقليدية تضم بروتوكولا معدلا يشرف عليه "فريق الخبراء الحكوميين"، الذي يجتمع سنويا لمناقشة هذه القضايا.

ومع أن اجتماع مايو/أيار 2023 شهد مسودة تقرير تدعو إلى تأكيد السيطرة البشرية على الأسلحة الذاتية، إلا أن الاجتماع فشل في الاتفاق على أطر تنظيمية ملزمة. وقد التزمت خمسون دولة دعم المسودة، لكنها أكدت أنها تمثل الحد الأدنى المطلوب، داعية إلى معايير قانونية أكثر صرامة وطموحا.

مساع دولية

في تصريح أثار الجدل، قال الرئيس الروسي فلاديمير بوتين إن "من سيتزعم الذكاء الاصطناعي سيحكم العالم". وفي سياق هذا السباق المحموم، خصصت الصين 150 مليار دولار لتحقيق الريادة العالمية في الذكاء الاصطناعي، بينما أنفقت روسيا 181 مليون دولار بين عامي 2021 و2023، وأنفقت الولايات المتحدة 4.6 مليار دولار خلال نفس الفترة.

وبحسب التوقعات، سيتم شراء أكثر من 80 ألف طائرة استطلاع وقرابة ألفي طائرة هجومية بدون طيار حول العالم خلال العقد المقبل.

كما أعلنت المملكة المتحدة خططا لاستثمار 415 مليون جنيه إسترليني في طائرات "بروتكتور" المسيرة في حلول عام 2024، وخصصت المملكة العربية السعودية، 69 مليار دولار ما يمثل 23٪ من موازنتها لعام 2023 للدفاع، وتخطط لإنشاء صندوق بقيمة 40 مليار دولار للاستثمار في الذكاء الاصطناعي، مما قد يجعلها أكبر مستثمر عالمي في هذا المجال.

مع تضخم الإنفاق العسكري، قد يصبح من الممكن ان تتخذ الطائرات المسيّرة قرارات فورية أثناء المعارك دون أي تدخل بشري، مما يهدد بإلغاء إمكان التفاوض السلمي لصالح ردود فعل آلية لا تعرف الرحمة.

وقد تطورت تكنولوجيا الطائرات المسيرة من مجرد وسائل رصد خلال حرب كوسوفو في 1999 إلى أدوات قتل دقيقة استخدمتها الولايات المتحدة بعد أحداث 11 سبتمبر، حيث نفذت نحو 14 ألف ضربة مسلحة بطائرات بدون طيار في أفغانستان بين عامي 2010 و2020.

رغم الطفرة التقنية، لم يتم حتى الآن استخدام أنظمة سلاح مستقلة بالكامل في المعارك دون إشراف بشري جوهري. ومع ذلك، فإن تزايد دمج الذكاء الاصطناعي في العمليات العسكرية يثير مخاوف أخلاقية وقانونية خطيرة، خصوصا في شأن قدرة الطائرات المسيّرة على التمييز بين المدنيين والمقاتلين.

حتى الآن، لا تزال معظم تقنيات الذكاء الاصطناعي تعمل ضمن نطاق محدود وتحت إشراف البشر. ولكن مع التقدم والتطوير، تزداد احتمالية أن تتخذ الآلات قرارات حاسمة في الحرب دون أي اعتبار للتعقيدات الأخلاقية.