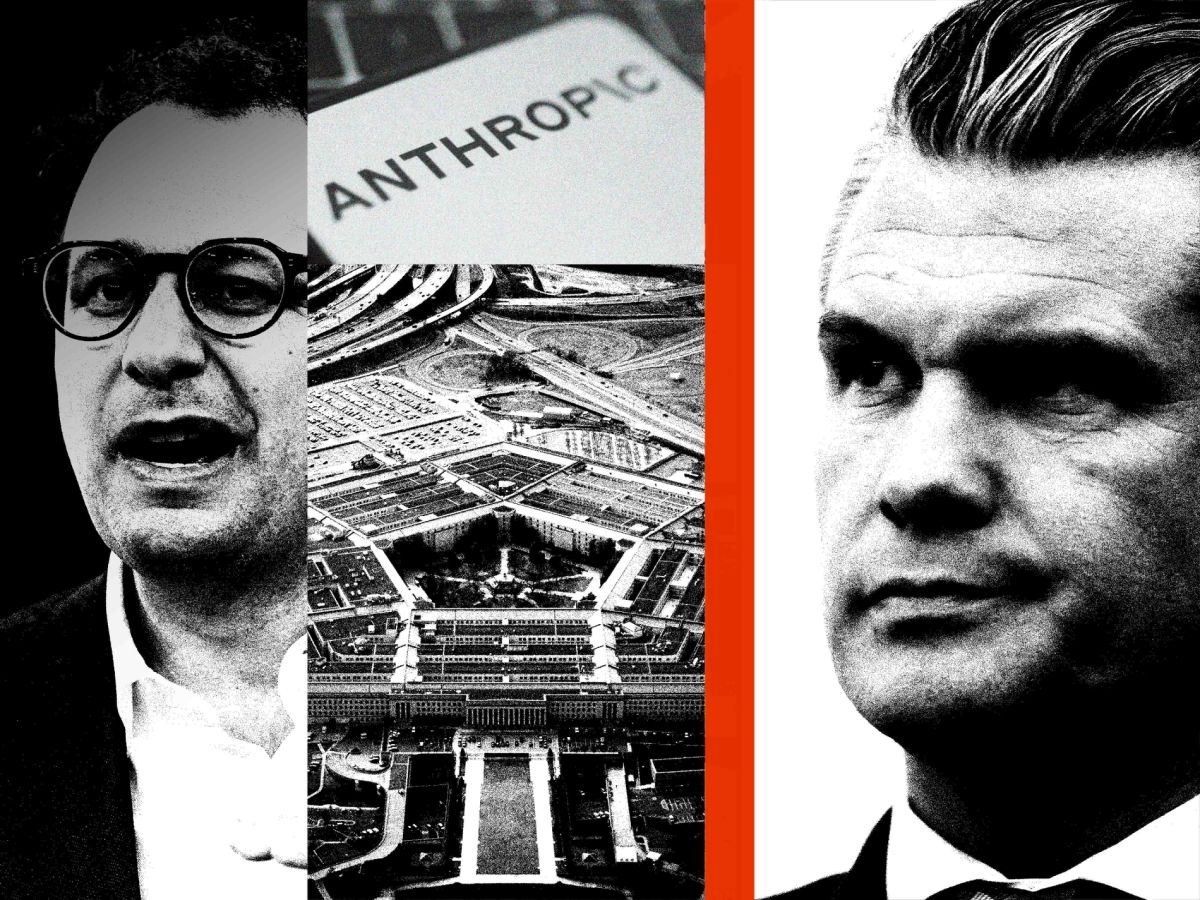

خلال ساعات من إعلان أن الحكومة الفيدرالية الأميركية ستنهي استخدام أدوات الذكاء الاصطناعي التي تصنعها شركة التكنولوجيا "أنثروبيك"، أطلق الرئيس دونالد ترمب هجوما جويا كبيرا في إيران بمساعدة تلك الأدوات نفسها.

وتستخدم قيادات عسكرية حول العالم، بما في ذلك القيادة المركزية الأميركية في الشرق الأوسط، أداة الذكاء الاصطناعي "كلود" التابعة لشركة "أنثروبيك". واستخدمت الأداة في تقييمات الاستخبارات، وتحديد الأهداف، ومحاكاة سيناريوهات المعارك.

وكانت الإدارة الأميركية وشركة "أنثروبيك" في خلاف منذ أشهر بشأن كيفية استخدام نماذج الذكاء الاصطناعي الخاصة بها من قبل وزارة الحرب الأميركية (البنتاغون)

وأمر ترمب يوم الجمعة الوكالات بوقف التعامل مع الشركة، كما صنّفت وزارة الدفاع الشركة على أنها تهديد أمني ومصدر خطر على سلسلة التوريد الخاصة بها. وجاء ذلك بعد أن رفضت الشركة السماح للبنتاغون باستخدام أدواتها في جميع السيناريوهات القانونية خلال مفاوضات العقد بين الطرفين.

ومع تدهور العلاقة بين"أنثروبيك" والبنتاغون، أبرمت وزارة الحرب الأميركية اتفاقيات لاستخدام نماذج منافسة، من بينها "تشات جي بي تي" التابعة لشركة "أوبن إيه آي"، و"إكس إيه آي" التابعة لإيلون ماسك، في بيئات سرية. وقال خبراء في الذكاء الاصطناعي إن استبدال "كلود" بهذه النماذج الأخرى سيستغرق عدة أشهر.

"لا يمكننا، وفقا لما يمليه علينا ضميرنا، الامتثال لطلبهم." بهذه العبارة القاطعة أعلنت شركة "أنثروبيك" رفضها الانصياع لطلب وزارة الحرب الأميركية (البنتاغون)، لتنتقل الأزمة من مرحلة المهلة والضغوط إلى مواجهة مباشرة بين واحدة من أبرز شركات الذكاء الاصطناعي في العالم وأقوى مؤسسة عسكرية على وجه الأرض. لم يكن التصريح مجرد رد رسمي عابر، بل إعلان موقف يجسد الهوية التي شيدت عليها الشركة سمعتها: فهي لا تكتفي بتطوير نماذج أكثر قوة، بل تحرص على أن تظل هذه القوة ضمن حدود تراها ضرورية لحماية الإنسان، حتى إن جاء الضغط من الدولة نفسها.

على مدى سنوات، قدمت "أنثروبيك" نفسها بوصفها الصوت الأخلاقي داخل صناعة الذكاء الاصطناعي، مؤكدة أن نموذجها "كلود" صمم ليبقى خاضعا للسيطرة البشرية وملتزما بأعلى معايير الأمان. غير أن هذا الالتزام وجد نفسه أمام أصعب اختبار، بعدما طالب البنتاغون برفع القيود التي تحد من استخدام النموذج في بعض التطبيقات العسكرية الحساسة. بالنسبة للمؤسسة العسكرية، لم يكن الطلب مسألة تقنية فحسب، بل تعبير عن رغبة في سيطرة كاملة على نظام بات جزءا من بنيتها التكنولوجية. أما بالنسبة للشركة، فالموافقة كانت تعني التخلي عن المبدأ الذي قامت عليه.

ما يجري ليس خلافا تعاقديا عاديا، بل لحظة صدام بين منطقين متعارضين، منطق الدولة التي ترى في الذكاء الاصطناعي أصلا استراتيجيا يجب أن يخضع بالكامل لأولويات الأمن القومي، ومنطق الشركة التي تؤكد وجود خطوط حمراء لا يجوز تجاوزها، حتى في مواجهة أكبر عميل محتمل. القبول كان سيمنح "أنثروبيك" موطئ قدم داخل منظومة النفوذ الدفاعي والتكنولوجي الأميركية، أما الرفض، الذي أصبح الآن أمرا واقعا، فيضعها على مسار مواجهة قد تعيد تشكيل مستقبلها، وربما تعيد رسم طبيعة العلاقة بين وادي السيليكون والبنتاغون ذاته.

جذور الأزمة

لم تتفجر الأزمة بين البنتاغون وشركة "أنثروبيك" فجأة هذا الأسبوع، بل تمتد جذورها إلى أواخر عام 2024، حين بدأ نموذج "كلود" يشق طريقه تدريجيا إلى بيئات حكومية حساسة، ضمن مبادرة أوسع أشرف عليها مكتب الذكاء الرقمي والاصطناعي الرئيس بوزارة الحرب الأميركية، في إطار ما عرف ببرنامج الذكاء الاصطناعي التوليدي التجريبي. وفي نوفمبر/تشرين الثاني 2024، عززت "أنثروبيك" هذا المسار عبر شراكة مع شركتي "أمازون ويب سيرفيسز" و"بالانتير"، لإتاحة النموذج داخل منصات الحوسبة الحكومية المؤمنة.

وسرعان ما تعمق التعاون؛ ففي يوليو/تموز 2025 حصلت الشركة على عقد رسمي بقيمة 200 مليون دولار مع البنتاغون لتطوير وتوفير قدرات ذكاء اصطناعي داخل البيئات الدفاعية. مثلت هذه الخطوة نقطة تحول مفصلية، إذ انتقل "كلود" من كونه أداة تخضع للاختبار إلى عنصر ضمن البنية التكنولوجية التي بدأت المؤسسة العسكرية تعتمد عليها فعليا.

آنذاك، لم ينظر إلى التطور بوصفه مثيرا للجدل، بل عد خطوة طبيعية في سياق سعي البنتاغون لتوظيف الذكاء الاصطناعي في تحليل التقارير الاستخباراتية وتسريع معالجة البيانات. وبفضل سمعته كنموذج يركز على الأمان وقابلية التحكم، أصبح "كلود" من بين الأنظمة التي تجاوزت مرحلة التجربة إلى الاستخدام داخل بعض الشبكات المرتبطة بالمؤسسة الدفاعية.